一种多功能警务终端智能头盔

本发明涉及警务头盔,尤其涉及一种多功能警务终端智能头盔。

背景技术:

1、在当今社会,随着技术的不断进步和警务需求的日益复杂化,执法人员在执行任务时对实时信息的获取和处理提出了更高的要求,增强现实技术、生成对抗网络以及多视角融合技术的迅速发展,使得技术在警务领域的应用成为可能,特别是在智能警务终端设备的开发中,具备实时信息传递和多视角同步显示能力的智能头盔逐渐成为研究和开发的重点。

2、现有的警务头盔设备虽然在某种程度上实现了视频监控、通讯功能,但在信息的实时性、准确性和多维度信息整合方面仍然存在诸多不足,同时,现有的警务头盔设备由于功能的单一性,通常仅能提供有限的视觉信息,且难以与ar技术有效结合,导致执法人员在现场操作中无法实时获取增强的空间感知信息,局限性在复杂多变的执法环境中表现得尤为突出,尤其是在低光照环境或其他视觉受限的条件下,现有设备难以提供清晰、准确的画面,进一步影响了执法人员的判断和反应能力,现有技术的警务头盔设计大多未能充分考虑到长时间佩戴的舒适性和电子设备的散热问题,在实际应用中会导致设备过热或佩戴不适,从而影响执法人员的持续作业能力。

3、针对上述现有技术的缺陷,迫切需要一种多功能警务终端智能头盔,以增强执法人员的现场感知能力,并且在设计上充分考虑到长时间佩戴的舒适性和设备的散热性能。

技术实现思路

1、本发明的一个目的在于提出一种多功能警务终端智能头盔,本发明提升了现场情况的综合判断能力和指挥决策的效率。

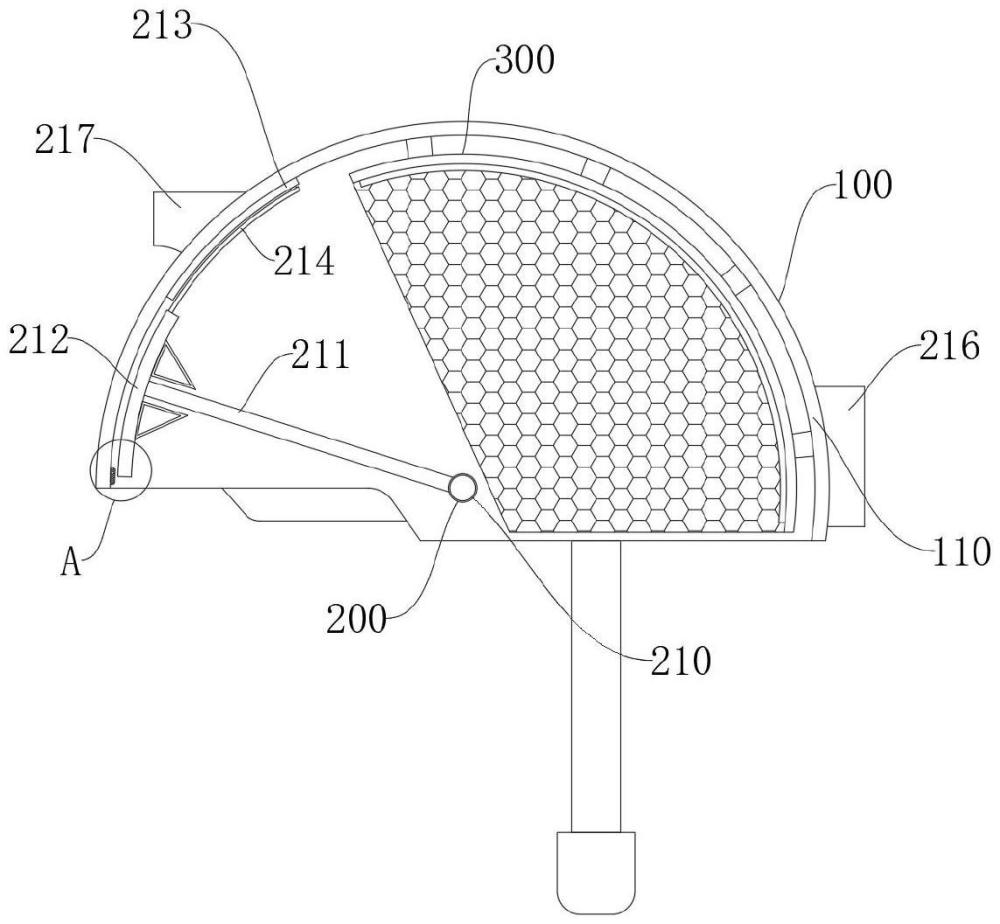

2、根据本发明实施例的一种多功能警务终端智能头盔,包括装置本体(100),所述装置本体(100)包括头盔主体(110),所述头盔主体(110)的内部设有识别组件(200),所述识别组件(200)通过两个安装轴(210)设置在头盔主体(110)的内壁两侧,所述安装轴(210)上铰接有支架(211),所述支架(211)远离安装轴(210)的端部固定安装有ar智能眼镜(212),所述头盔主体(110)的外侧固定安装有摄像头(217),所述头盔主体(110)的外侧固定安装有电池仓(216),所述摄像头(217)外部的头盔主体(110)外侧固定安装有补光组件,所述头盔主体(110)的内部设有散热组件(300)。

3、可选的,所述头盔主体(110)的内壁一侧安装有和ar智能眼镜(212)相贴合的清洁条(215),所述头盔主体(110)的内壁固定安装有滑轨(213),所述滑轨(213)的内部滑动安装有滑块,所述滑轨(213)内部的滑块外侧固定安装有和ar智能眼镜(212)相连接的连接片(214),所述散热组件(300)包括等距安装于头盔主体(110)内壁的橡胶柱(312),所述橡胶柱(312)的底端固定安装有散热架(310),所述散热架(310)上均匀贯穿开设有通孔,所述散热架(310)的内表面等距安装有海绵条(311)。

4、可选的,,所述识别组件(200)内嵌入式安装有中央处理器,所述中央处理器内集成有ar智能眼镜模块,多视角摄像头模块和双层生成对抗网络模块,所述识别组件(200)的识别方法包括:

5、s1、在警务头盔中集成ar智能眼镜模块,在佩戴者眼镜视野中叠加显示图像,并实时获取佩戴者的第一视角视频画面;

6、s2、在警务头盔上安装多视角摄像头模块,捕捉警务人员周围环境的多角度视频图像集;

7、s3、将第一视角视频画面和多角度视频图像集输入至头盔内置的双层生成对抗网络进行处理,第一层生成对抗网络的第一生成器,从多角度视频图像集中生成去噪、超分辨率重建及低光照增强的图像;

8、s4、第一层生成对抗网络的第一判别器区分由第一生成器生成的增强多角度视频图像集与原始多角度视频图像集之间的差异,优化生成的多角度视频图像集的真实感;

9、s5、第二层生成对抗网络的第二生成器,融合经过第一层生成对抗网络处理的多角度视频图像集,生成具有增强空间感知能力的多视角融合图像;

10、s6、第一层生成对抗网络的第二判别器训练由第二生成器生成的多视角融合图像在视觉上连贯一致;

11、s7、将经过s6步骤中双层生成对抗网络处理后的多视角融合图像实时在ar智能眼镜模块中叠加显示,并与佩戴者的第一视角视频画面同步显示,优化佩戴者的现场感知能力。

12、可选的,所述s1包括以下步骤:

13、s11、在警务头盔的ar智能眼镜模块中配置图像处理单元,图像处理单元用于接收由摄像头(217)中多视角摄像头模块获取的实时视频数据,并将实时视频数据转换为适合ar显示的数字信号,生成第一视角视频画面v1;

14、s12、利用ar智能眼镜模块中的图像叠加处理器,将增强现实信息iar与第一视角视频画面v1进行叠加,生成叠加后的显示图像v′1:

15、v′1=v1+α1×iar;

16、其中,v′1为叠加后的显示图像,v1为第一视角视频画面,iar为增强现实信息,α1为图像叠加权重系数;

17、s13、通过ar智能眼镜模块中的显示单元,将叠加后的显示图像v′1实时投射到佩戴者的ar智能眼镜(212)中;

18、s14、通过集成在ar智能眼镜(212)中的传感器单元,实时监测佩戴者的头部姿态和视线方向,动态调整显示图像v′1的显示位置和角度。

19、可选的,所述s2包括以下步骤:

20、s21、在警务头盔的多视角摄像头模块中配置多个摄像头单元,每个摄像头单元设定在不同的方向上,用于捕捉警务人员周围环境的不同角度的视频图像,生成多角度视频图像集:

21、d={v21,v22,,v2n};

22、s22、对每个摄像头单元获取的原始多角度视频图像集进行预处理,包括图像去噪、色彩校正及分辨率增强,生成视频图像v′2i,其中i为摄像头单元的编号,v′2i为原始视频图像,v′2i为经过预处理的视频图像;

23、s23、将预处理后的多角度视频图像集d′={v′21,v′22,…,v′2n}存储于头盔内置的图像数据存储单元中,并通过内置的通信模块将多角度视频图像集d′实时传输至警务头盔的图像处理单元。

24、可选的,所述s3包括以下步骤:

25、s31、将第一视角显示图像v′1和经过预处理的多角度视频图像集d′输入至头盔内置的双层生成对抗网络模型的第一层生成器g1中,第一层生成器使用卷积神经网络对输入数据进行特征提取,得到特征映射集

26、s32、在第一生成器g1中对特征映射集进行处理,生成去噪、超分辨率重建及低光照增强的图像集d″;

27、s33、将第一层生成器g1生成的增强图像集d″输入至第一层判别器d1中,第一层判别器通过对比生成图像集d″与原始图像集d′的特征,计算其差异度量函数ldiff(d″,d′):

28、

29、其中,为第一层判别器d1中的特征提取函数,ldiff为增强图像与原始图像的差异度量,n为图像数量,d1∥·∥2为欧氏距离度量,用于量化图像之间的相似性;

30、s34、根据第一层判别器d1计算的差异度量函数ldiff(d″,d′)对第一层生成器g1的参数进行反向传播更新:

31、

32、其中,η为学习率,为第一层生成器的参数向量,通过梯度下降法对参数向量进行调整,减少增强图像与原始图像之间的差异,逐步优化双层生成对抗网络模型的性能,直至生成的图像集d″达到预设的质量标准。

33、可选的,所述s32包括以下步骤:

34、s321、在第一生成器g1中,使用去噪函数ddenoise对特征映射集中的每个图像特征映射进行去噪处理,去除图像中的噪声成分,得到去噪后的特征映射

35、

36、其中,k为高斯混合模型的成分数,wk为高斯成分的权重,μk和σk分别为高斯成分的均值和方差,为输入的特征映射,为去噪后的特征映射;

37、s322、对去噪后的特征映射使用超分辨率重建函数进行处理,优化图像的分辨率,得到超分辨率重建后的特征映射

38、

39、其中,*表示卷积操作,h为卷积核,λ为正则化参数,为图像梯度,为经过超分辨率重建后的特征映射;

40、s323、对超分辨率重建后的特征映射使用低光照增强函数εlle进行处理,优化图像在低光照条件下的视觉效果,得到最终增强后的特征映射

41、

42、其中,∈为避免除零的微小量,α2为亮度调整参数,为经过低光照增强处理后的特征映射;

43、s324、将去噪处理、超分辨率重建及低光照增强后的特征映射进行汇总处理,生成最终的增强图像集d”:

44、

45、其中,为特征映射的概率分布函数,d″为最终生成的增强图像集,表示对所有图像进行处理并汇总,为每个图像的最终增强结果。

46、可选的,所述s5包括以下步骤:

47、s51、将经过第一层生成对抗网络处理后的增强图像集d″输入至第二层生成对抗网络模型的第二生成器g2中,第二生成器g2对输入的增强图像集进行特征提取,生成特征映射集

48、s52、使用第二生成器g2中的多视角融合函数对特征映射集进行融合,生成具有增强空间感知能力的多视角融合特征映射

49、

50、其中,γij为多视角融合的自适应权重,*表示卷积操作,ωj为融合过程中的卷积核,exp为指数函数,μij和σij分别为高斯混合模型中的均值和标准差参数,用于描述不同特征映射之间的相似性和重要性;

51、s53、对融合后的多视角特征映射进行重构,生成具有增强空间感知能力的多视角融合图像vfusion:

52、

53、其中,τ为重构函数,δl为重构权重,relu为线性整流函数,ηij为融合特征映射的权重参数,γl为重构卷积核,ξl为偏置项,ζ为重构过程中的调整项。

54、可选的,所述s7包括以下步骤:

55、s71、将经过s6步骤中双层生成对抗网络处理后的多视角融合图像vfusion与佩戴者的第一视角视频画面v1进行实时同步,使用同步映射函数ssync对两者进行空间和时间上的对齐处理,得到同步融合图像vsync:

56、vsync=ssync(vfusion,v1)=α3·vfusion+(1-α3)·v1;

57、其中,α3为融合权重系数,用于控制多视角融合图像与第一视角视频画面的融合程度,vsync为同步后的融合图像;

58、s72、通过ar智能眼镜模块中的显示处理单元,将同步融合图像vsync实时叠加显示在佩戴者的视野中,并根据佩戴者的视线方向和头部姿态调整图像显示位置和角度;

59、s73、利用ar智能眼镜模块中的实时反馈机制,持续监测佩戴者的环境变化和动作,动态调整同步融合图像vsync的显示内容和显示方式,优化佩戴者的现场感知能力。

60、本发明的有益效果是:

61、(1)本发明通过集成多视角摄像头模块和双层生成对抗网络模型,成功解决了现有技术中信息传递延迟和视角单一的问题,第一层生成对抗网络能够对来自多角度的视频图像集进行去噪、超分辨率重建及低光照增强,从而生成高质量的图像集,随后,第二层生成对抗网络进一步融合经过增强的图像集,生成具有更强空间感知能力的多视角融合图像,提升了现场情况的综合判断能力和指挥决策的效率。

62、(2)本发明利用ar智能眼镜模块将多视角融合图像与执法人员的第一视角视频画面进行同步叠加显示,提高了信息显示的实时性和准确性,增强了执法人员在现场的空间感知能力,在复杂和多变的执法环境中,同步融合显示有效弥补了传统单一视角显示的局限性,使得执法人员能够在获取全面环境信息的同时,快速做出反应。

63、(3)本发明在双层生成对抗网络的设计中,结合卷积神经网络用于特征提取、去噪和超分辨率重建,并通过引入多视角融合函数实现对特征映射的自适应权重调整,提高了图像处理的精度,降低了计算的复杂性,保证了多视角融合图像的实时生成和显示。

64、(4)本发明在智能头盔的设计中,充分考虑了长时间佩戴的舒适性和内部电子设备的散热问题,通过散热架和橡胶柱组合设计,保证头盔在使用过程中的良好空气流通,避免了热量积聚,显著提升了佩戴的舒适度和设备的稳定性。

技术研发人员:秦振凯,蒙晓霞,陈悦,张世乐,莫耀凯,刘雨欣,郑璧旋

技术所有人:广西警察学院

备 注:该技术已申请专利,仅供学习研究,如用于商业用途,请联系技术所有人。

声 明 :此信息收集于网络,如果你是此专利的发明人不想本网站收录此信息请联系我们,我们会在第一时间删除